全球首個具備模擬推理能力的具身模型來了!

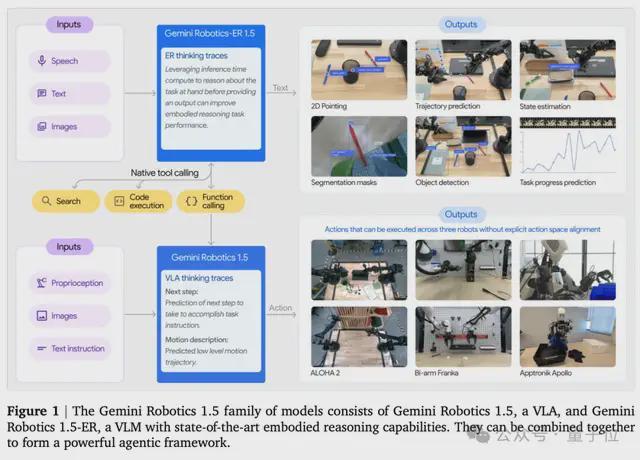

谷歌DeepMind正式發布新一代通用機器人基座模型——Gemini Robotics 1.5系列。

它不止于對語言、圖像進行理解,還結合了視覺、語言與動作(VLA),并通過具身推理(Embodied Reasoning)來實現“先思考,再行動”。

這一系列由兩大模型組成:

- Gemini Robotics 1.5(GR 1.5):負責動作執行的多模態大模型;

- Gemini Robotics-ER 1.5(GR-ER 1.5):強化推理能力,提供規劃與理解支持。

其中,ER代表“具身推理”。

這意味著GR-ER 1.5是全球首個具備模擬推理能力的具身模型。

不過,GR-ER 1.5并不執行任何實際操作,GR 1.5正是為執行層而生。

兩者結合,能讓機器人不僅完成“折紙、解袋子”這樣的單一動作,還能解決“分揀深淺色衣物”甚至“根據某地天氣自動打包行李”這種需要理解外部信息、分解復雜流程的多步任務。

甚至,它能根據特定地點的特定要求(比如北京和上海的不同垃圾分類標準),自己上網搜索,以幫助人們完成垃圾分類。

而且用上GR 1.5系列的模型,還能夠在多種不同的機器人之間進行能力的零樣本跨平臺遷移。

Unbelivable~

毫不夸張地說,這是谷歌繼Gemini 2.5之后,又一個將通用AI推向現實世界的重要里程碑。

哈斯比斯也激動表示:

- GR 1.5以多模態Gemini為基礎,展示了其能夠理解并推理物理世界的強大功能。

未來機器人將變得至關重要——我們對這項開創性工作感到非常興奮!

GR 1.5系列五大能力展示

先來看一段視頻——

我們來把GR 1.5系列在發布中展示的能力,總結為五個關鍵詞:

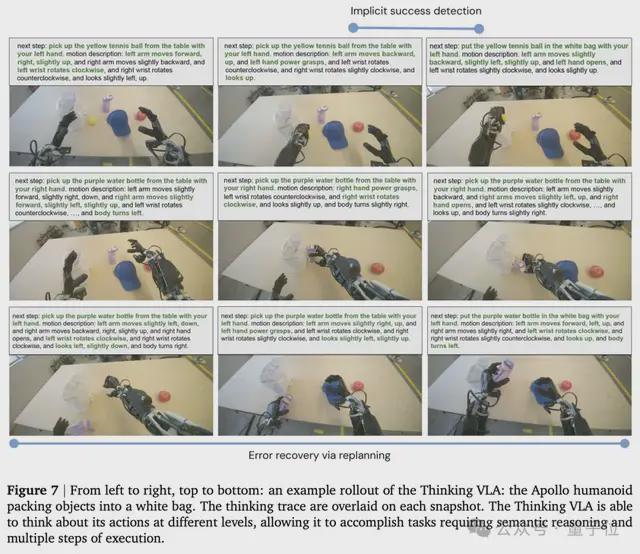

執行復雜長程任務,中間還能自我檢測并修正

不僅限于一次抓取、一次搬運,GR 1.5能執行包含多步子任務的長流程。

比如:

- 把不同顏色的衣服分類;

- 從衣柜取出雨衣,再打包進行李箱;

- 在廚房完成配料準備,甚至嘗試烹飪流程。

在GR 1.5這里,任務被分解成多個階段,機器人逐一完成。